文章来源:

腾赚网

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 wulanwray@foxmail.com 举报,一经查实,本站将立刻删除。

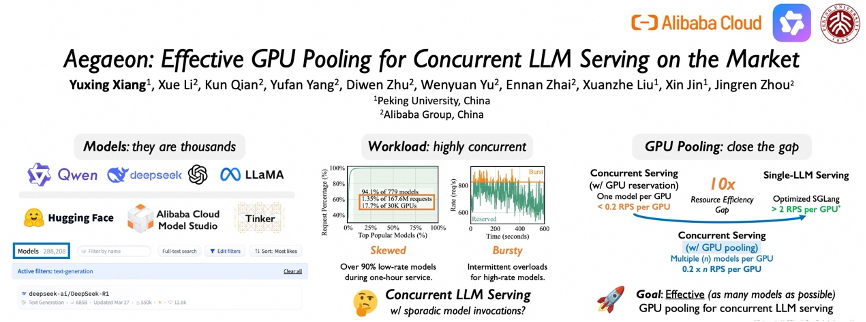

阿里云自研的计算池化方案“Aegaeon”成功入选全球顶级学术会议SOSP 2025,引发业界关注。该方案直击AI模型服务中GPU资源浪费的痛点,通过打破“一个模型独占一张GPU”的传统模式,实现多模型共享同一张GPU。其核心技术已在阿里云百炼平台落地,支持单GPU同时运行最多7个不同模型,有效吞吐量提升1.5至9倍,请求处理能力翻倍。

在真实场景测试中,Aegaeon将服务720亿参数大模型所需的英伟达H20 GPU从1192张锐减至213张,节省高达82%。这背后是token级调度与全栈优化的协同发力:系统在生成每个token后动态切换模型,结合显存精控、组件复用和KV缓存同步技术,模型切换开销降低97%,响应速度进入亚秒级。随着AI发展从拼硬件转向拼效率,Aegaeon为释放现有算力潜能提供了关键路径。

抱歉,评论功能暂时关闭!