文章来源:

腾赚网

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 wulanwray@foxmail.com 举报,一经查实,本站将立刻删除。

国产大模型企业DeepSeek近日引发资本市场关注。其最新发布的DeepSeek-V3.1模型采用了UE8M0 FP8 Scale参数精度,并明确指出该标准是为下一代国产芯片量身打造。消息一出,寒武纪等芯片类上市公司股价应声上涨。资本市场热情高涨,但产业界反应更为冷静。

FP8是一种更低的数值精度标准,用于提升AI训练和推理的效率。相比传统的FP32,FP8将数据宽度压缩至8位,大幅降低存储和通信开销。摩尔线程AI Infra总监陈志表示,FP8不仅能提升算力效率,还能减少带宽压力,让相同功耗下训练更大模型成为可能。不过,也有业内人士指出,FP8并非万能,精度太低可能导致计算误差,实际应用中仍需混合精度方案来平衡效率与准确性。

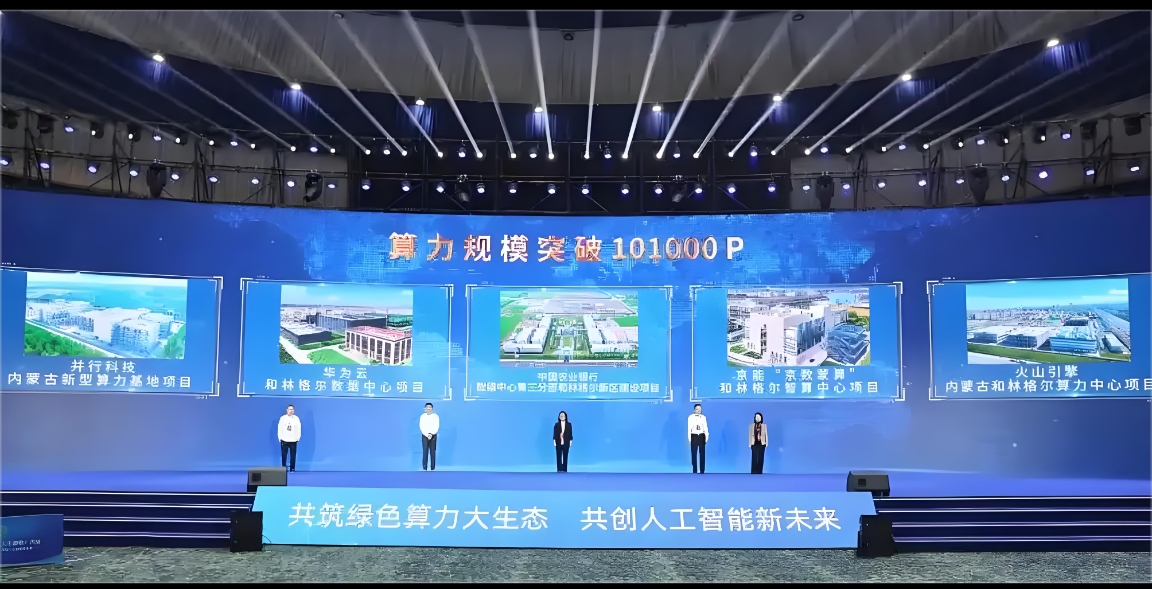

在2025算力大会上,DeepSeek的这一动作被看作国产算力迈向新阶段的信号。尽管其技术潜力受到认可,但能否成为行业新标准,仍需看后续落地效果。陈志认为,大模型对低精度的容忍度逐步提高,FP8是未来研究的重要方向。与此同时,国产算力生态也需同步升级,从芯片、框架到应用层都要联动优化。算力提升不只是堆硬件,单卡效率与集群调度的协同优化同样关键。

抱歉,评论功能暂时关闭!